Pytorch for dummy

Originariamente impletato da META ora fa parte della Linux foundation

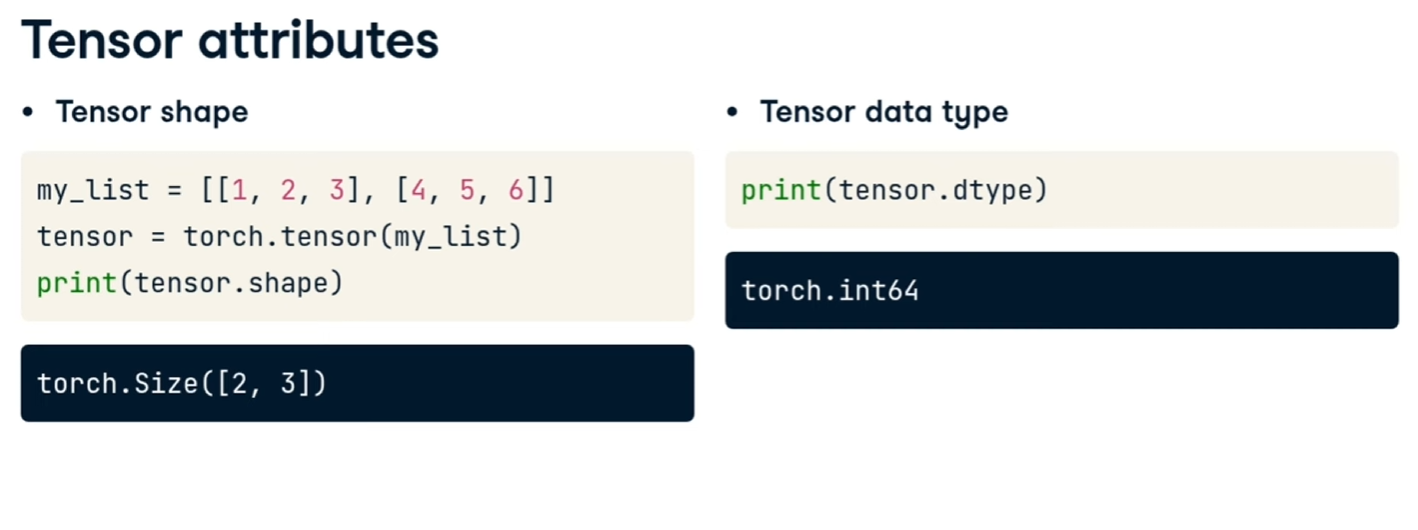

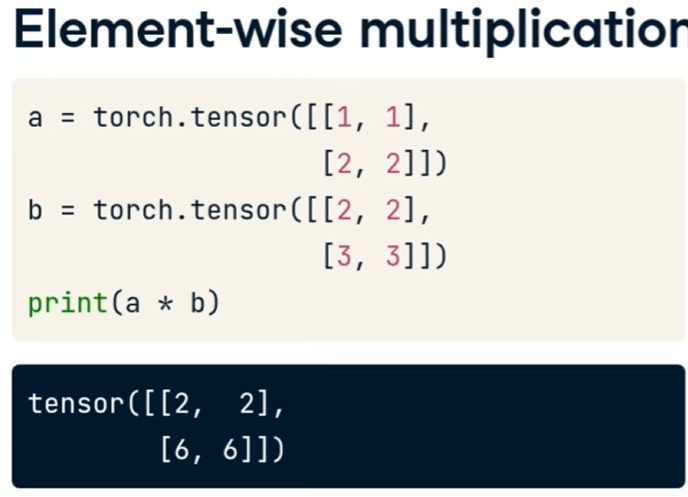

La base di tutto è il tensore, che non è altro che una matrice (o un array) sulla quale PT consente tutta una serie di operazioni, un po' come numpy, es:

es:

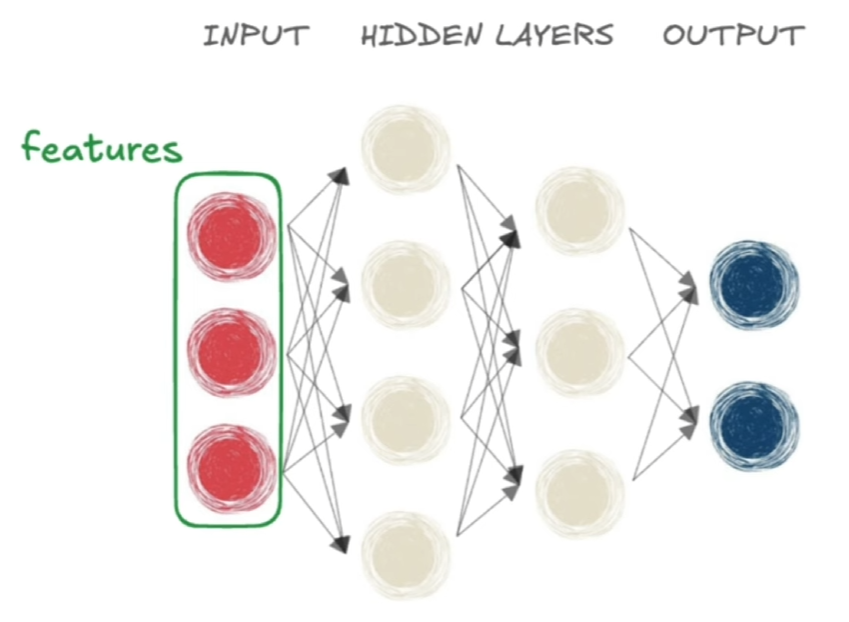

Layer della rete neurale

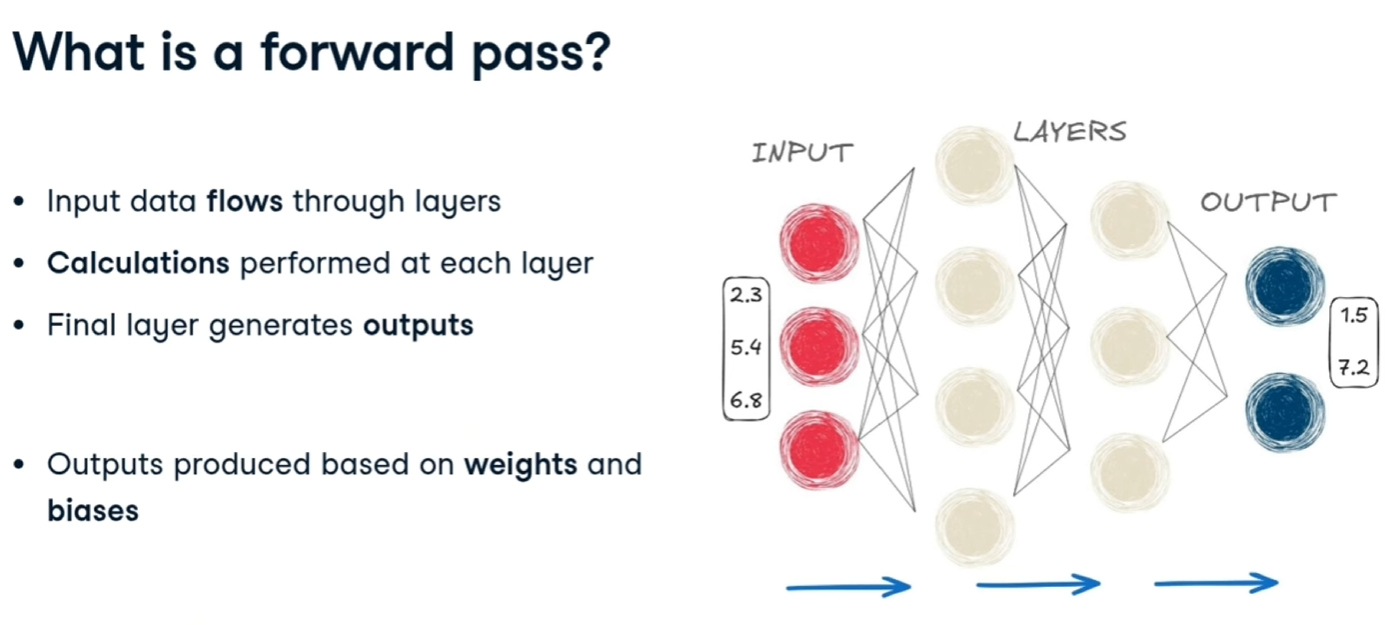

la parte in rosso sono gli input della rete, detta "features", la parte in grigio sono i layer "nascosi", mentra la parte di blu è l'output layer ovvero l'output desiderato.

Classificatori

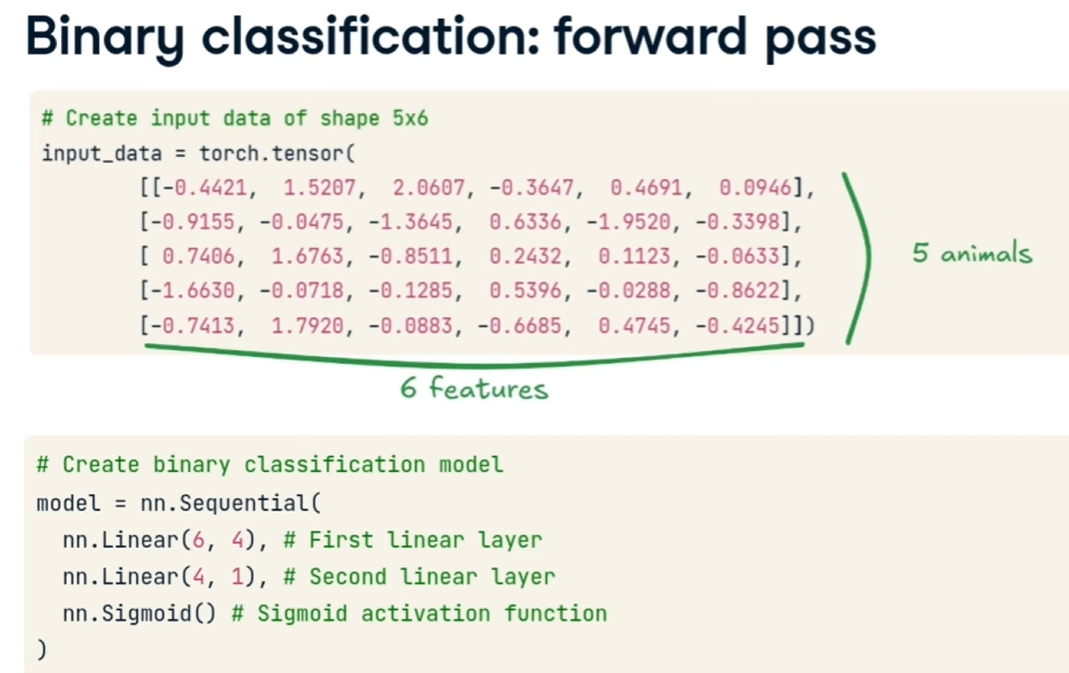

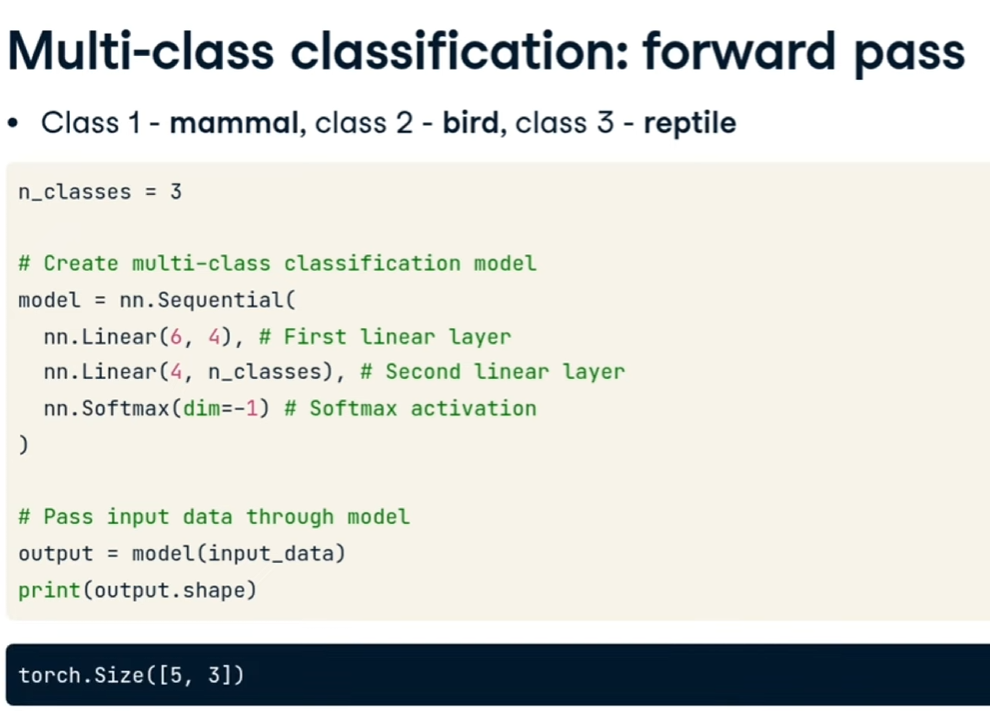

Le funzioni possono essere:

- Sigmoid per la classificazione binaria (un unico output con un valore compreso tra 0 e 1)

- Softmax per la multi classificazione, va messo come ultimi layer della rete neurale. (dove l'ultimo livelo di neurino definice il numero di valori da classificre)

- yy per la regressione, ovvero per predirre un flusso continuo di valori numerici, in questo caso non verrò inserita nessuna funzione di attivazione

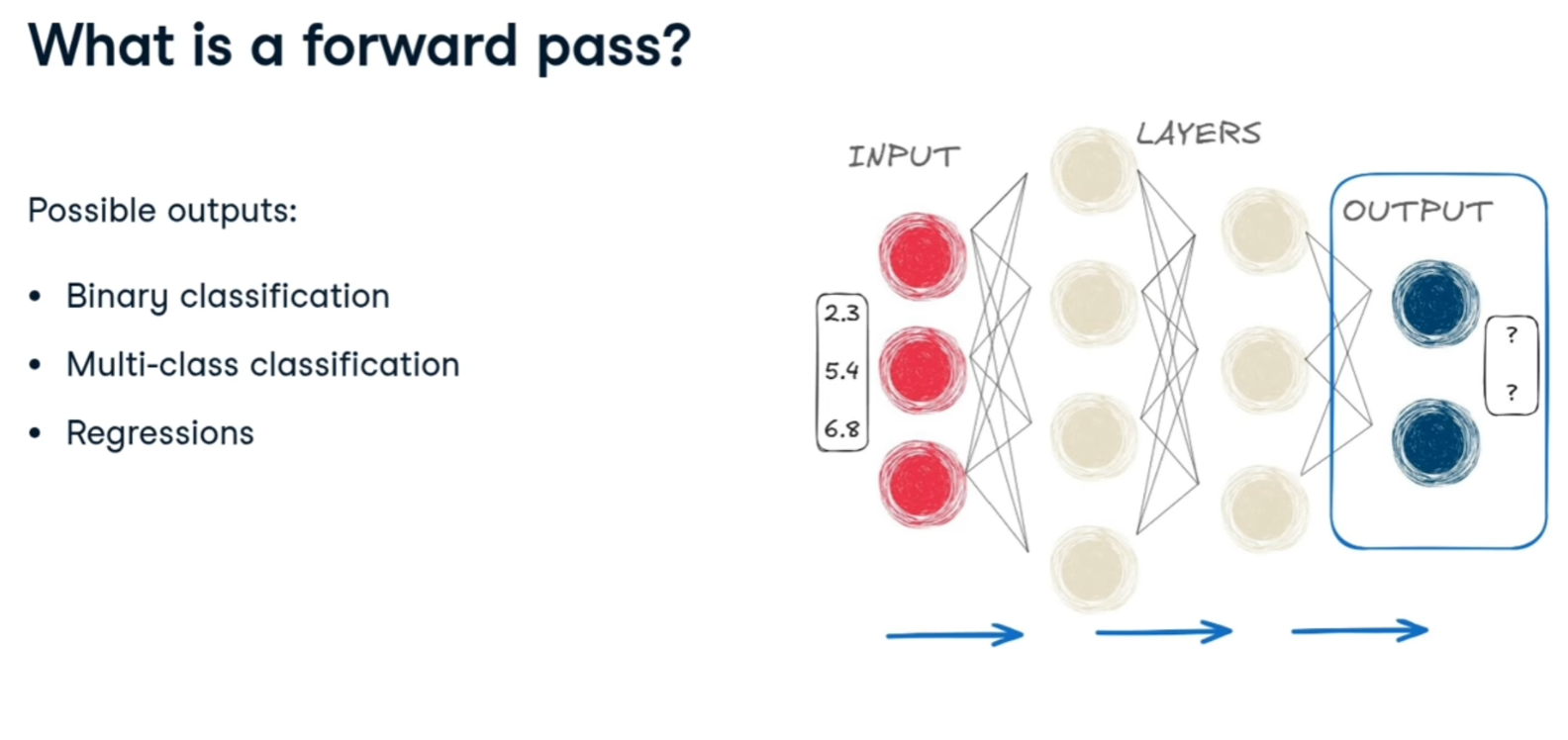

Forward pass

è l'operazione di passaggio dei pesi e del bias da un layer della rete a quello successivo